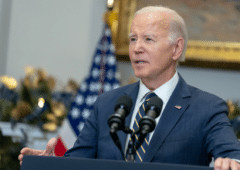

Ce vendredi, les plus grandes entreprises du secteur de l’intelligence artificielle comme OpenAI, Google, Microsoft ou encore Meta étaient invitées à la Maison Blanche pour discuter avec le président américain Joe Biden. Les géants de la tech se sont engagés à prendre des mesures pour rendre l’IA plus sûre.

Mettre des garde-fous à l’intelligence artificielle, voilà l’un des principaux chantier sur lequel les gouvernements de la planète planchent depuis l’essor foudroyant de ChatGPT. Le Far West légal dans lequel évolue l’IA soulève bien des problèmes, notamment en matière de droits de la propriété intellectuelle, qui ont valu à OpenAI et Microsoft d’être attaqués en justice.

Pour les organisations du secteur il s’agit maintenant de rassurer les gouvernements. Ainsi, ce sont pas moins de sept entreprises qui étaient conviées à la Maison Blanche hier pour discuter avec Joe Biden de mesures pour rendre l’intelligence artificielle plus sûre : OpenAI, Google, Amazon, Meta (qui lançait cette semaine son modèle open source LlaMA 2), Anthropic, Inflection ainsi que Microsoft.

Quelles sont les mesures proposées pour rendre l’intelligence artificielle plus sûre ?

L’administration Biden a déclaré que les entreprises s’étaient engagées à prendre des mesures, comme l’essai minutieux des outils d’IA avant leur lancement, le partage d’informations sur les manières de réduire les risques liés à l’IA et d’investir dans la cybersécurité.

Parmi les mesures proposées figure également le marquage systématique des contenus générés par intelligence artificielle. C’est déjà le cas des contenus générés par DALL-E, avec son petit watermark de toutes les couleurs en bas de l’image. Mais ce nouveau système irait plus loin, en marquant toutes les formes de contenu, qu’il s’agisse de textes, d’images, d’audios ou de vidéos générées par l’IA, afin que les utilisateurs sachent qu’une technologie du type a été utilisée.

À lire > Intelligence artificielle : un ancien cadre de Google prédit l’apocalypse

Pour l’administration Biden, ces promesses sont déjà une victoire. Le parlement américain étudie actuellement un projet de loi qui obligerait les publicités politiques à indiquer si l’IA a été utilisée pour créer des images. Mais les entreprises du secteur elles-mêmes appellent à l’adoption d’une législation plus complète : Sam Altman, PDG d’OpenAI, déclarait récemment avoir tellement peur de sa création qu’il en faisait des insomnies.