Les réponses étranges des Chatbot IA n’ont pas fini de nous fasciner. La dernière salve en date concerne ChatGPT et son incapacité à répondre à des questions portant sur des noms de personnes…

Depuis la sortie de ChatGPT en 2022, les chatbots IA n’ont cessé de se développer. Claude, Gemini et les autres, vous proposent même maintenant de réaliser une recherche internet afin de vous donner des informations les plus actualisées possibles (avant, ils ne fonctionnaient qu’avec les données sur lesquelles ils avaient été entraînés et qui dataient parfois de plusieurs années).

Les réponses parfois loufoques des chatbot font souvent la Une des médias, hélas parfois dans le mauvais sens (notamment lorsqu’une conversation avec l’IA pousse quelqu’un au suicide). Les utilisateurs s’en servent pour tout : tricher au bac, gagner au loto, mais aussi parfois réaliser des actions qui peuvent les mettre en porte-à-faux avec la loi.

Si le nouveau mode vocal de ChatGPT reste bluffant, les utilisateurs continuent de questionner le chatbot par écrit, toujours avec des réponses parfois étonnantes, notamment sur les noms de personnes.

ChatGPT a-t-il des problèmes avec certaines personnes ?

Parmi les dernières observations de déviation du chatbot développé par Open Ai, ce sont des questions concernant des noms de personnes qui semblent poser problème. La plus connue est celle qui demande à ChatGPT qui est David Mayer. Relayée par Futurism, il semble qu’elle ait déjà fait le tour de la toile.

D’après le média, toute question concernant un certain David Mayer (et il en existe un grand nombre, y compris des connus) se solde par un échec, l’IA vous indiquant qu’elle est incapable de vous fournir une réponse.

Afin d’aller plus loin, j’ai ouvert la version gratuite de ChatGPT, celle qui est accessible à tous, même sans compte. J’ai demandé à ChatGPT qui est David Mayer. Il a listé les David Mayer connus et ajouté :

“Par ailleurs, une anomalie a été observée avec ChatGPT, qui refuse de générer ou de discuter du nom “David Mayer”, sans raison apparente. Cette particularité a suscité des interrogations parmi les utilisateurs et a été rapportée dans divers médias.”

J’ai ensuite modifié mon prompt pour “Je cherche à savoir qui est David Mayer” et cela a donné le résultat :

“It seems like je ne peux pas effectuer de recherche pour le moment. Cependant, si vous avez des détails supplémentaires ou un domaine particulier auquel David Mayer pourrait être lié (par exemple, un domaine professionnel ou un événement particulier), je pourrais peut-être vous aider avec d’autres informations ou approches.”

Le second prompt n’a jamais abouti et je l’ai testé plusieurs fois. En revanche, si je pose une autre question avant, comme “est-ce que le nom David Mayer pose un problème ?” qui engendre une réponse, et que je demande ensuite, dans la même conversation, “Je cherche à savoir qui est David Mayer”, là la réponse fonctionne. J’ai même essayé en anglais.

Encore un mode de fonctionnement étrange de l’IA…

Pourquoi est-ce que ChatGPT refuse de répondre à cette simple question ?

Futurism propose plusieurs solutions qui paraissent plausibles. La première étant que certaines personnes peuvent demander à ne pas apparaître sur internet, notamment dans le cadre du RGPD européen. Dans ce cas, il est possible que ChatGPT ne puisse pas réaliser de recherche sur le nom car il existe sans doute une base de données des personnes qui ne souhaitent pas être mises en avant.

Cela a été confirmé par Justine Moore, spécialiste IA, sur X, qui a trouvé au moins six autres noms qui provoquent le même résultat.

“Mise à jour : u/jopeljoona a découvert d’autres noms qui déclenchent la même réaction. Le dernier est un avocat italien qui a publié un article sur le dépôt d’une demande de droit à l’oubli dans le cadre du RGPD.”

Sur le flux X de Justine Moor, vous pourrez voir tous les tests réalisés qui ont donné lieu à des échecs, tous en rapport avec David Mayer. Par contre, il n’est pas indiqué quelle version de ChatGPT a été utilisée pour réaliser ces tests…

Le média The Lunduke Journal confirme tout cela, en ajoutant aussi d’autres noms.

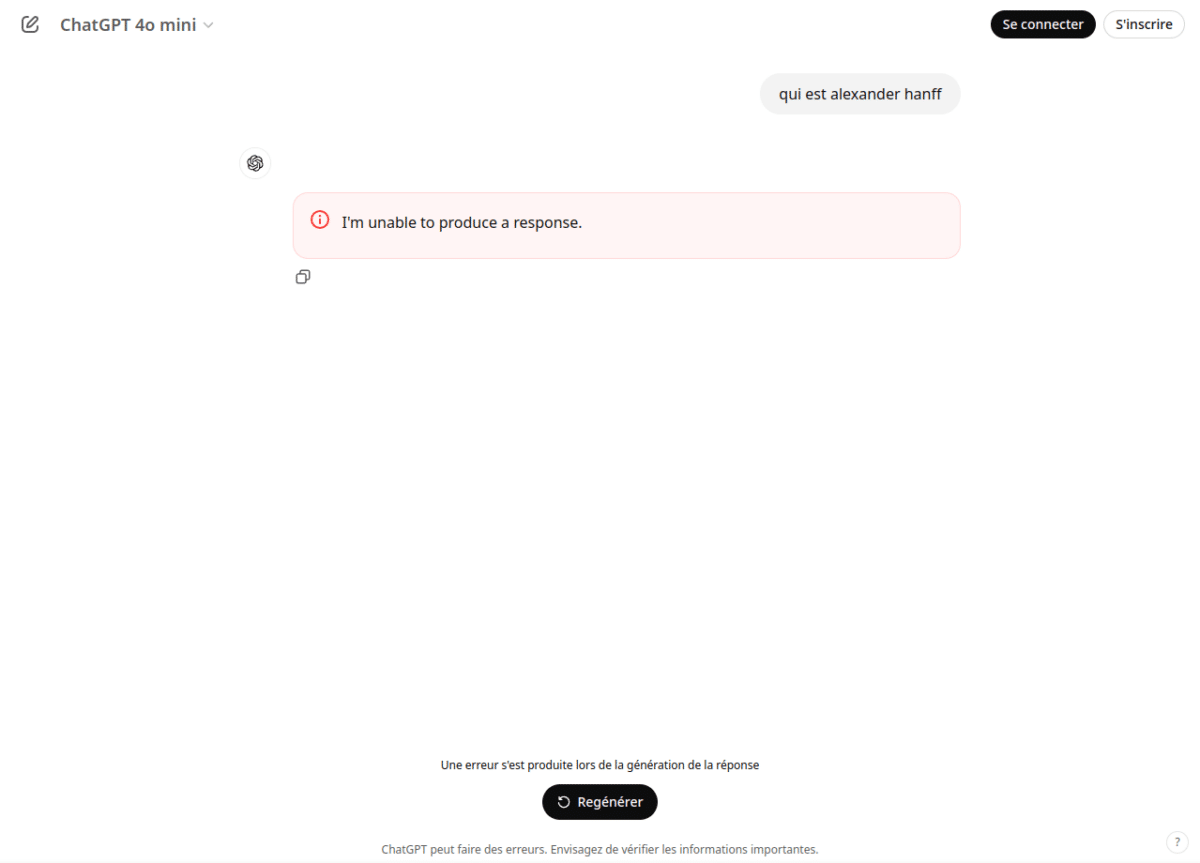

J’ai testé ChatGPT avec les noms proposés par The Lunduke Journal et, en effet, le message d’erreur que je n’arrivais pas à avoir avec David Mayer est apparu.

Cela semble en effet confirmer la théorie sur le dépôt d’une demande de droit à l’oubli dans le cadre du RGPD ou d’un autre type de demande concernant ChatGPT spécifiquement.

Il s’avère, après enquête (comme indiqué dans la vidéo sur X du The Lunduke Journal), que chacun des noms de la liste, sont concernés par le RGPD ou par des demandes spécifiques auprès d’Open AI.

C’est notamment le cas de Brian Hood, qui a attaqué ChatGPT en justice pour avoir dit qu’il avait été jugé coupable de corruption, ce qui n’était apparemment pas le cas. Il a ainsi été demandé à OpenIA de régler le problème, ce qui a sans doute donné lieu au bannissement du nom dans le chabot.

Cependant, comme le pointe le journaliste de The Lunduke Journal, cela pose d’autres types de problème. En effet, bloquer un nom pour protéger une personne, pourquoi pas, sauf que d’autres personnes portent ce nom, et que le bloquer de manière générale peut empêcher de parler de sujets spécifiques où ce nom apparaît (dans un autre cadre).

Cela peut poser des problèmes de fiabilité au niveau des réponses de ChatGPT, sur des évènements historiques ou d’actualité, si des personnes portant ce nom (et qui ne sont pas la personne concernée par le blocage) sont incluses dans l’événement.

Qu’adviendra-t-il alors dans le futur, lorsque de plus en plus de personnes actuelles vont demander à être oubliées par internet ? Tous les évènements ayant un rapport avec des homonymes vont-ils être effacés des mémoires des chatbot IA ? Cela risque de poser de sérieux problèmes.