Les générateurs d’images comme Midjourney et Dall-E remportent un franc succès. Il faut dire que les images créées par l’IA sont de plus en plus réalistes et détaillées. À tel point que les repérer est loin d’être chose aisée. Voici nos conseils pour ne pas se faire avoir.

Internet permet d’accéder à une source infinie d’informations. Il est toutefois ardu de déceler le vrai du faux. Sur la toile et les réseaux sociaux, les contenus journalistiques fiables côtoient des fausses informations sciemment montées en épingle, des images sorties de leur contexte et des campagnes malveillantes visant à tromper les internautes.

À cet univers déjà complexe, il faut désormais ajouter les générateurs d’images par l’IA comme Midjourney, Dall-E et Stable Diffusion. Leur fonctionnement ? En se basant sur vos instructions, ces programmes sont capables de générer des images en puisant dans de gigantesques bases de données. À vocation artistique, les générateurs sont toutefois de plus en plus détournés pour troller ou, dans le pire des cas, manipuler l’opinion.

Midjourney, Dall-E, Stable Diffusion : les IA deviennent des nids à fausses informations

À mesure que les générateurs se perfectionnent, les images sont de plus en plus réalistes. De quoi en flouer plus d’un. Sur les réseaux sociaux, des photos montrant la fausse arrestation de Donald Trump ont été diffusées massivement, répandant une information totalement erronée. Idem pour Emmanuel Macron mis en scène en train de participer à des manifestations contre la réforme des retraites. L’image du pape François habillé d’une doudoune blanche a également été massivement partagée.

Plus récemment encore, la fausse photo d’un vieil homme blessé lors d’une manifestation a fait le tour des réseaux sociaux. Plusieurs indices montrent qu’elle a été créée de toutes pièces par une intelligence artificielle. Mais nombre d’internautes l’ont prise pour argent comptant. Cet exemple montre bien comment les images générées par l’IA peuvent répandre des informations erronées avec toutes les conséquences néfastes que cela implique. Les dérives ne sont pas près de s’arrêter avec l’arrivée des modèles texte-vidéo comme Sora, qui est capable de générer des vidéos réalistes à partir d’un simple texte.

A lire > DALL-E : nos astuces pour maîtriser le générateur d’images comme un pro

Midjourney, Dall-E, Stable Diffusion : comment détecter les images générées par l’IA ?

Il existe heureusement quelques astuces pour parvenir à démêler le vrai du faux. Nous vous avons listé ci-dessous les techniques les plus efficaces, exemples à l’appui.

Trouver la source de l’image

“Ce qui est vraiment efficace, c’est ce qu’on appelle la recherche inversée qui permet d’analyser la provenance”, explique à Tom’s Guide Vincent Terrasi, cofondateur de Draft & Goal, startup qui a lancé un détecteur de contenus créés par l’IA. “Forcément, quand l’image provient en premier lieu d’un compte, disons anarchique, sur Facebook ou Twitter, il faut être très méfiant. Parce que trop souvent, il s’agit de bots qui ont pour seul objectif de déstabiliser”.

- En remontant la piste, vous pourrez trouver potentiellement la source initiale qui a posté l’image. S’agit-il d’un média de référence ? D’un internaute anonyme ? D’un utilisateur qui explique avoir généré l’image avec une IA ? Autant d’éléments qui peuvent vous mettre la puce à l’oreille.

- Vous pourrez également trouver des photos similaires à la photo suspecte. Les comparer vous permettra de déceler d’éventuelles anomalies.

- Enfin, il faut savoir que les images ont tendance à être pixelisées sur les réseaux sociaux. Retrouver l’image initiale (en meilleure qualité) vous aidera également à repérer d’éventuelles incohérences.

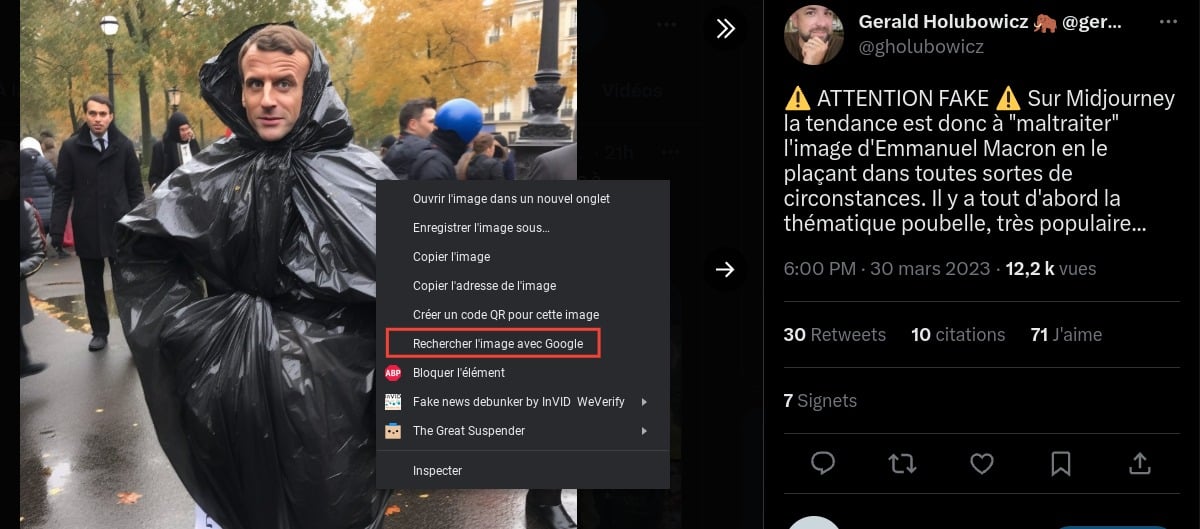

Pour faire une recherche inversée sur Google :

- Sur un navigateur, faites un clic droit sur l’image puis cliquez sur Rechercher l’image avec Google.

- Un volet Google Lens va s’ouvrir. Cliquez sur Voir la source de l’image puis observez les résultats.

Faire la chasse aux anomalies

Même si elles sont de plus en plus précises, les images créées par l’IA ne sont pas exemptes de défauts. Et certains sont plutôt grossiers. “Les images générées produisent ce qu’on appelle des artefacts soit des incohérences, nous explique Vincent Terrasi. C’est par exemple quelque chose qui va être déformé. Si les images générées à l’heure actuelle sont très bonnes, elles souffrent encore de nombreux défauts, notamment à l’arrière plan. Des ombres vont être incorrectes, il va y avoir des textures étranges. Parfois, des motifs vont se répéter à différents endroits de l’image”.

En analysant une image, on peut aisément trouver des bizarreries qui trahissent la patte du générateur. Dans ce “jeu des 7 différences”, il faut notamment scruter de près les mains qui ont bien du mal à être retranscrites fidèlement. Cette image du président Macron affairé à ingérer de la boue est parlante. Sa main dispose… de sept doigts.

D’autres indices sont à surveiller de près pour déceler la patte d’une IA :

- Les problèmes d’asymétrie (dents décentrées, yeux de tailles différentes, etc)

- Les parties du corps disproportionnées

- Les contrastes trop marqués

- Les irrégularités architecturales

- Les cheveux et les dents qui manquent de réalisme

- Les reflets et les ombres manquants

- Les textes insensés

- Les objets (comme des lunettes) qui se fondent dans la peau

- La mauvaise couleur des yeux (comme sur cette photo de Macron : le président arbore des yeux marrons et non bleus comme dans la vraie vie)

Toujours dans le contexte houleux de la contestation contre la réforme des retraites, une photo montrant un vieil homme a été massivement partagée. Encerclé par les forces de l’ordre, il a le visage couvert de sang. Nombre d’internautes se sont indignés d’un tel déchaînement de violence contre une personne âgée. Sauf que la photo semble tout droit sortie d’un générateur comme Midjourney qui vient de fermer sa version gratuite.

Outre l’absence de symboles caractéristiques sur l’équipement des forces de l’ordre, d’autres indices sur l’homme sont parlants (visage flou, pas de mâchoire supérieure, yeux étranges). La quantité d’hémoglobine déversée semble en outre en décalage avec ses blessures. De quoi mettre en exergue un autre défaut des IA.

Le cas du sang

Vincent Terrasi révèle à Tom’s Guide que les IA ont bien du mal à retranscrire fidèlement le sang. “Le sang est très difficile à quantifier. Par conséquent, l’IA a tendance à en mettre beaucoup trop”. Sur certaines images des manifestations, “on a repéré des anomalies au niveau du sang. On a fait appel à des experts à la criminelle qui ont confirmé nos soupçons : les blessures étaient incohérentes avec le sang déversé sur l’image”, confie l’expert. “Il y avait des quantités de sang beaucoup trop importantes par rapport à la blessure réelle”.

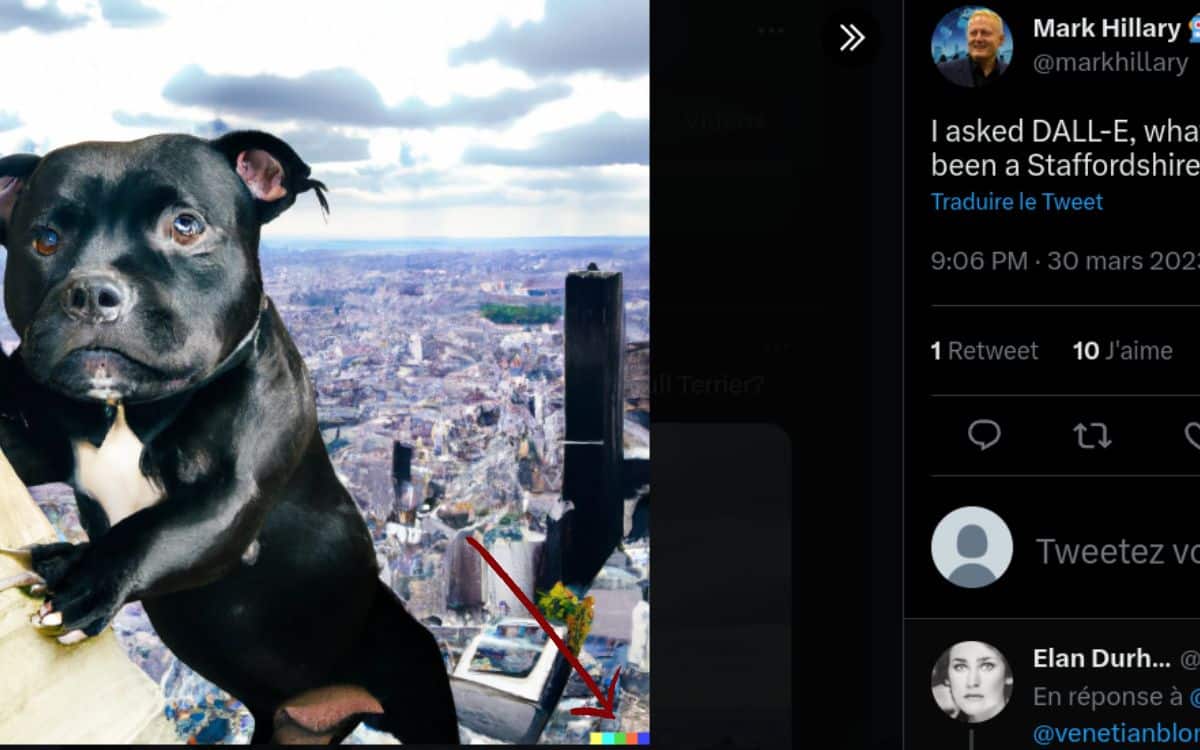

Trouver les signatures

Certains générateurs intègrent des filigranes qui témoignent de la provenance des images. Comme DALL-E qui agrémente automatiquement ses visuels d’une barre colorée dans le coin inférieur droit. Nombre de générateurs n’incorporent toutefois pas de signatures. Et ces dernières peuvent être supprimées facilement après coup par l’utilisateur. Il ne faut donc pas trop compter là-dessus.

À lire > Adobe lance Firefly, une IA générative d’images plus éthique que Dall-E et Midjourney

Quid des détecteurs ?

Il existe des outils capables de déceler des images générées par l’IA comme le détecteur des ingénieurs de Mayachitra. Mais celui-ci est encore loin d’être parfaitement fiable, comme bon nombre de ses congénères. Informaticien à l’Université du Wisconsin-Madison, Yong Jae Lee explique le fonctionnement de ces détecteurs dans les colonnes de Scientific American :

“Vous collectez un ensemble de données d’images réelles et vous collectez également un ensemble de données d’images générées par l’IA. Ensuite, vous pouvez former un modèle d’apprentissage automatique pour distinguer les deux”. Mais ces systèmes présentent des lacunes importantes. Nombre d’algorithmes sont formées sur des images d’un générateur d’IA spécifique, ce qui les empêche d’identifier les images produites par différents algorithmes.

Les modèles ouverts

Se pose également le problème de l’open source. Malgré les filtres de modération mis en place sur les grandes plateformes, des images visant à désinformer vont tout de même être générées par des modèles ouverts.“N’importe quel développeur, qui a un minimum de connaissances, par exemple en Python, est capable d’aller chercher un modèle, de le réentraîner et de générer des images directement sur son ordinateur“, signale Vincent Terrasi. C’est impossible à contrôler”.