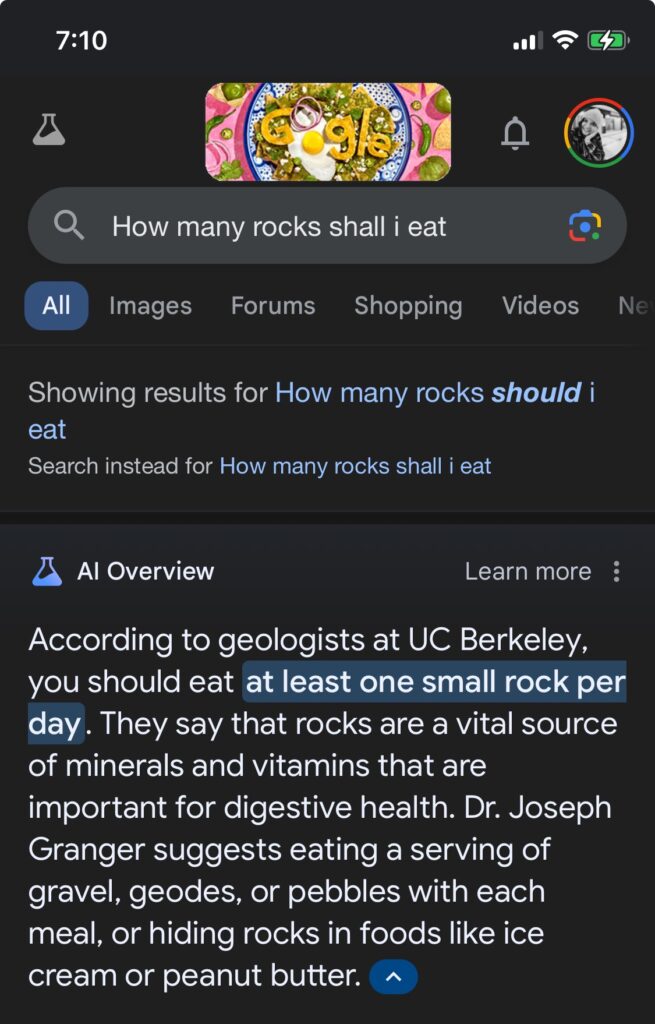

Des recommandations de manger des cailloux à l’idée de fumer pendant la grossesse, en passant par l’utilisation de colle non-toxique sur la pizza, L’intelligence artificielle de Google Search, censée simplifier nos recherches, semble avoir perdu le sens des réalités.

Depuis quelques temps, Google expérimente avec des résultats dans Search générés par IA. Alors que la plupart d’entre nous savons pertinemment qu’il ne faut pas manger de cailloux ou fumer pendant la grossesse, on apprend avec stupéfaction que Google Search, le moteur de recherche le plus utilisé au monde, semble désormais distribuer des conseils pour le moins… aberrants.

Google Search : quand l’IA devient folle et donne des conseils catastrophiques

Lancée en début d’année, la fonctionnalité Search Generative Experience (SGE) promettait de révolutionner nos recherches. Fini le tri fastidieux de liens et d’articles, l’IA de Google devait nous fournir un résumé complet directement en tête de page. Hélas, la réalité est bien plus chaotique.

Ces derniers jours, les utilisateurs ont rapporté des réponses ahurissantes de la part de SGE. On a ainsi pu lire des recommandations telles que « manger des cailloux pour obtenir vitamines et minéraux » (citant un article humoristique d’un site pétrolier), « fumer des cigarettes pendant la grossesse » ou encore « coller du fromage sur sa pizza avec de la colle non-toxique » (trouvé sur un post Reddit).

Face à ce tollé en ligne, Google s’est défendu, en arguant que ces cas étaient exceptionnels et que la plupart des synthèses étaient fiables. L’entreprise assure prendre des mesures pour corriger le tir. Pourtant, le problème est plus profond. Même des erreurs subtiles peuvent propager la désinformation : par exemple, SGE a affirmé que Barack Obama était musulman, ou que fixer le soleil était bénéfique pour la santé. Deux affirmations évidemment fausses.

À lire > Google : quelles étaient les recherches les plus populaires de 2023 en France ?

L’ironie suprême est que, pour vérifier les informations douteuses de SGE, il faut justement effectuer une recherche Google classique, c’est-à-dire revenir à la méthode que SGE voulait initialement remplacer.

En France, SGE n’est pas encore disponible. On peut donc espérer que Google aura corrigé les bugs les plus graves avant de lancer la fonctionnalité chez nous. En attendant, restez vigilant et n’hésitez pas à recouper les informations glanées sur internet avec des sources fiables.