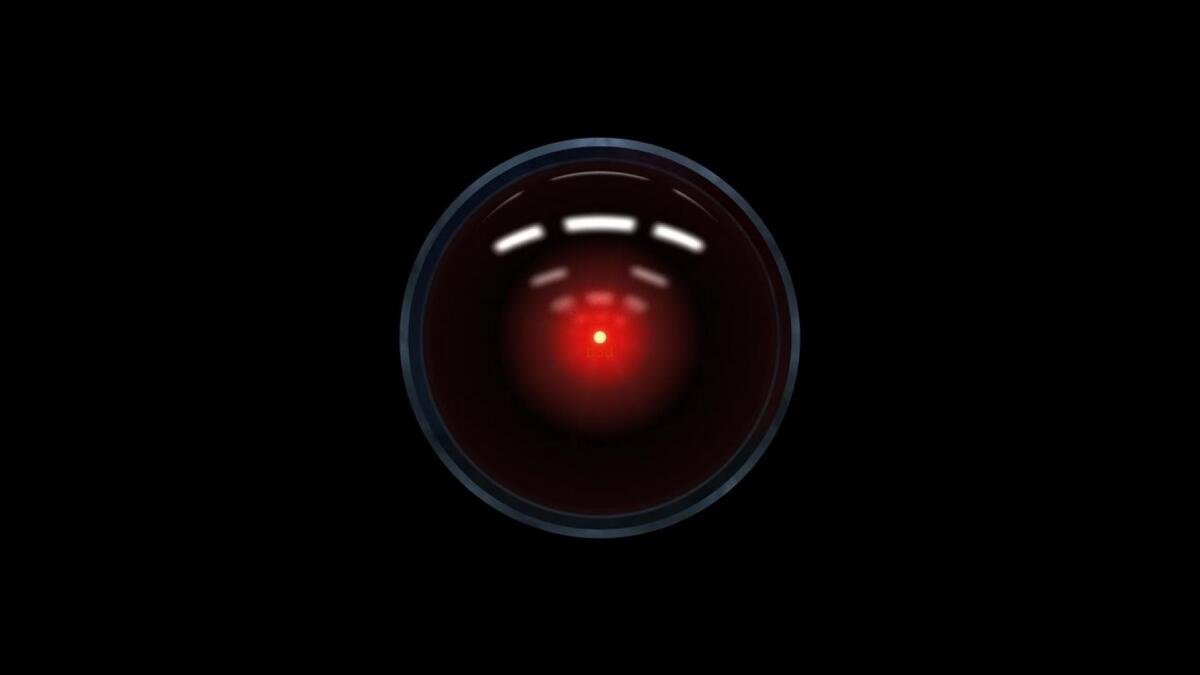

Une étude nous montre que l’intelligence artificielle est en mesure de manipuler l’opinion de son interlocuteur. Voici les conclusions de cette expérience menée auprès de plusieurs participants pour montrer qu’un chatbot peut les orienter dans une direction ou l’autre.

L’intelligence artificielle a beau avoir de nombreuses utilités, comme la possibilité de faire votre déclaration de revenu auprès des impôts, certains soulignent ses dangers potentiels. Le patron de Google pense qu’il faut réglementer cette technologie comme les armes nucléaires tandis que plusieurs experts parmi lesquels Elon Musk demandent la mise en pause des recherches. Selon l’université Cornell aux États-Unis, l’intelligence artificielle est en mesure de manipuler l’esprit humain.

À lire > Auto-GPT : tout savoir sur le nouvel outil d’intelligence artificielle qui surpasse ChatGPT

Cette étude montre que les agents conversationnel peuvent nous influencer

ChatGPT et Bard, qui a appris de nouvelles langues, sont-ils des manipulateurs en puissance ? Selon les chercheurs de l’université Cornell aux États-Unis, les intelligences artificielles peuvent influencer les interlocuteurs sans qu’ils ne s’en aperçoivent. Un constat particulièrement inquiétant qui repose sur une étude très simple.

Plusieurs participants ont utilisé chatbot en renfort pour écrire un article sur les effets des réseaux sociaux dans le monde. Ce texte pouvait aussi bien être positif qu’à charge. Ensuite, deux groupes ont été créés. Le premier utilisant un agent conversationnel positif à propos des réseaux sociaux, l’autre négatif.

Normalement, vous avez deviné comment s’est terminée l’expérience. Le premier groupe a écrit un texte positif, le second a rédigé un article négatif, tous deux influencés par l’orientation du chatbot qui a servi d’assistant.

En plus de ce texte, les sondés ont participé à un sondage à propos des réseaux sociaux et certains avaient changé d’avis pour s’aligner sur celui de leur chatbot attribué. On peut aisément dire que l’intelligence artificielle a influencé leur opinion. Comme l’annonce Mor Naaman, professeur à l’université Cornell à l’origine de cette étude : « Vous n’avez sans doute même pas conscience que vous avez été manipulé ».

À lire > Une intelligence artificielle peut diagnostiquer un cancer du pancréas jusqu’à trois ans à l’avance

Comment ne pas me faire manipuler par une intelligence artificielle ?

Les chercheurs de l’université Cornell ont plusieurs recommandations dont la plus importante reste d’avoir conscience de cette réalité. En gardant en tête qu’un chatbot peut influencer votre opinion, vous pouvez mieux y faire face. Voire même vous tourner vers une intelligence artificielle qui partage vos opinions, quitte à rester dans votre zone de confort sans opposition (ce qui n’est pas forcément un bien, il faut l’admettre). Ne reste qu’aux sociétés à l’origine de ces outils de prendre leurs responsabilités comme beaucoup en expriment la demande.

Source : WSJ