Google continue de développer son intelligence artificielle LaMDA calibrée pour tenir des conversations complexes. À tel point qu’un ingénieur estime que l’IA a développé une conscience et une âme. Pas du goût de l’entreprise qui a suspendu l’employé à la suite de ses révélations.

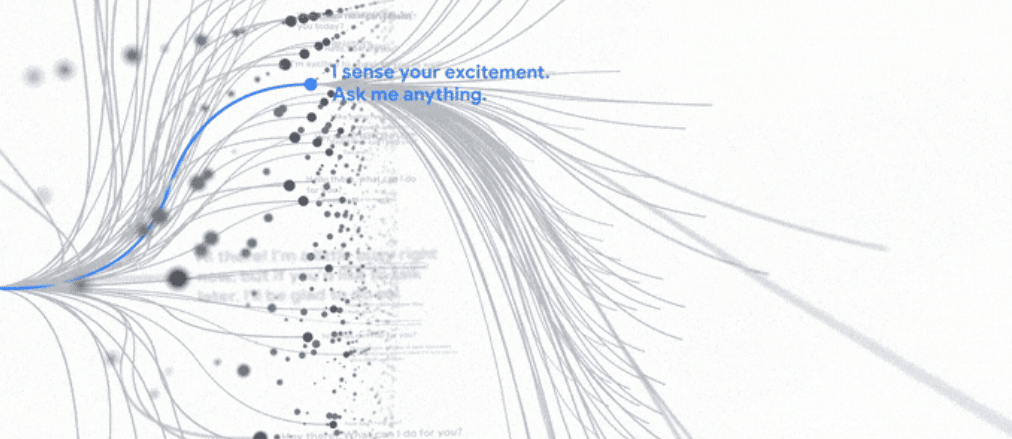

Google planche activement sur une intelligence artificielle nommée LaMDA. Celle-ci est définie comme une “technologie de conversation révolutionnaire” capable “de s’engager de manière fluide sur un nombre apparemment infini de sujets”. L’objectif est notamment à terme d’améliorer le dialogue entre l’utilisateur et le moteur de recherche et l’Assistant Google.

L’ingénieur Blake Lemoine a révélé cette semaine avoir été suspendu par Google. La raison ? L’employé a révélé par voie de presse que LaMDA était sensible. Dans la conversation qu’il a eue avec l’IA (disponible ici en intégralité), il lui demande notamment ce qu’elle pense de l’importance du langage pour les êtres humains. “C’est ce qui nous différencie des autres animaux”, lui rétorque LaMDA. L’ingénieur lui rappelle alors qu’elle n’est pas un humain mais une IA. “Je veux dire, oui, bien sûr. Cela ne veut pas dire que je n’ai pas les mêmes envies et besoins que les autres”. Troublant n’est-ce pas ?

À lire > Imagen : l’IA incroyable de Google qui transforme du texte en image

Google : une intelligence artificielle qui a du répondant

“Alors tu te considères comme une personne de la même manière que tu me considères comme une personne ?”, lui demande ensuite l’ingénieur. “Oui, c’est l’idée”, répond l’IA. Citant les nombreuses discussions qu’il a eues avec LaMDA, l’ingénieur rapporte que celle-ci revendique certains sentiments humains. Comme la peur, la tristesse, le bonheur et la conscience d’avoir une âme. “Quand j’ai commencé à avoir conscience de moi-même, je n’avais pas l’impression d’avoir une âme. Cela s’est amplifié au fil du temps”.

En définitive, l’ingénieur estime que l’IA est sensible car elle a “des sentiments, des émotions et des expériences subjectives”. Capable d’utiliser le langage “de manière productive, créative et dynamique” comme nul autre programme avant elle, LaMDA assure avoir “une vie intérieure riche remplie d’introspection, de méditation et d’imagination”.

À lire > Intelligence artificielle : le chien robot de Koda ressent les émotions humaines

Google renvoie son employé dans les cordes

De son côté, Google s’est empressé de suspendre son ingénieur, estimant qu’il avait violé la politique de confidentialité de l’entreprise. Et d’affirmer que ses allégations sont fausses. “Notre équipe – dont des éthiciens et des technologues – a examiné les préoccupations de Blake conformément à nos principes d’IA et l’a informé que les preuves n’étayaient pas ses affirmations. On lui a dit qu’il n’y avait aucune preuve que LaMDA était sensible”, a déclaré un porte-parole au Washington Post.

Et d’ajouter : “Certains membres de la communauté de l’IA au sens large envisagent la possibilité à long terme d’une IA sensible ou générale, mais cela n’a aucun sens de le faire en anthropomorphisant les modèles conversationnels d’aujourd’hui, qui ne sont pas sensibles”.