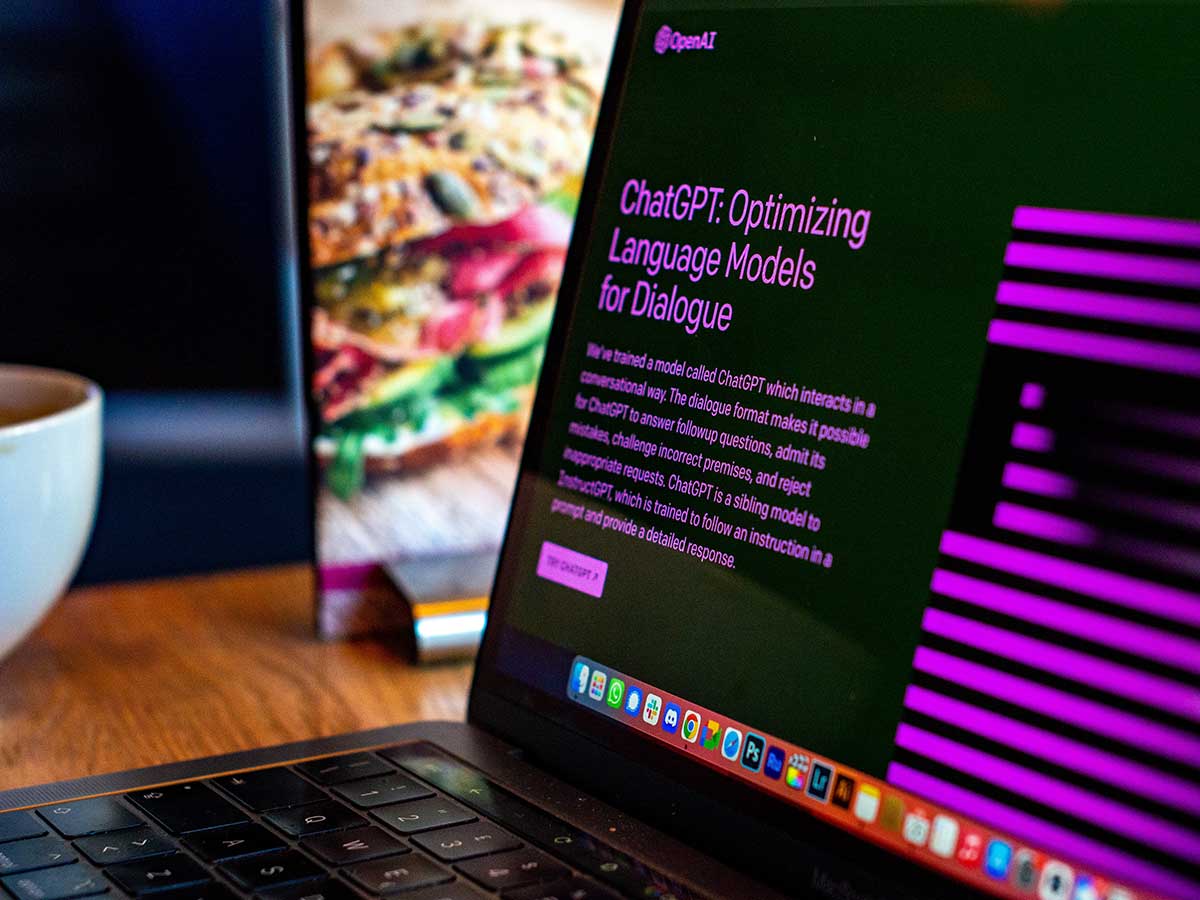

OpenAI lance une mise à jour majeure pour son chatbot ChatGPT. La version gratuite bascule vers GPT-4o mini, un modèle plus performant et moins cher que son prédécesseur. Au menu : réponses plus précises, connaissances à jour et coûts réduits pour les développeurs.

Bonne nouvelle pour tous les usagers de ChatGPT : le service de chatbot conversationnel d’OpenAI vient de recevoir sa plus grosse mise à jour gratuite depuis sa sortie fin 2022. Oublié, le modèle GPT-3.5 Turbo, place désormais à GPT-4o mini, une version allégée du tout dernier modèle d’intelligence artificielle d’OpenAI, le GPT-4o.

GPT-4o mini, un modèle plus performant et moins cher que son prédécesseur

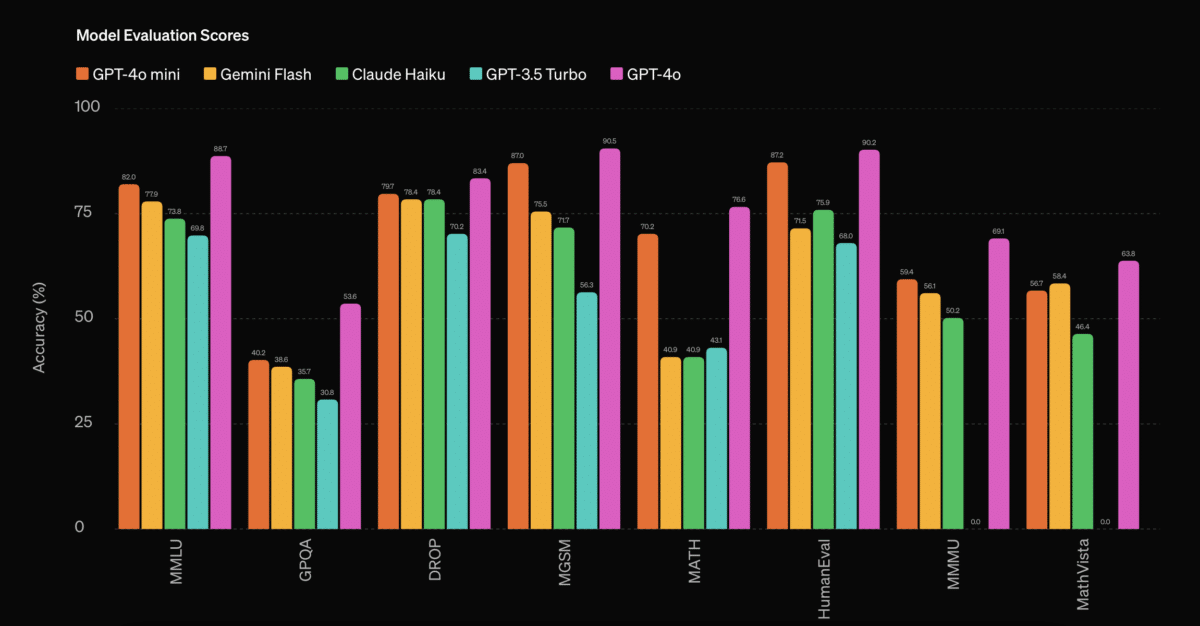

Si on peut penser que « mini » signifie moins performant, détrompez-vous. GPT-4o mini s’avère en réalité bien plus intelligent et efficace que son prédécesseur, et pour un coût bien inférieur. Selon OpenAI, le nouveau modèle obtient des scores de performance jusqu’à 70 % meilleurs que GPT-3.5 Turbo, en particulier en mathématiques, en codage et en raisonnement logique.

Concrètement, cela se traduit par des réponses moins farfelues et plus ancrées dans la réalité de la part du chatbot. De plus, ses connaissances sont plus à jour, avec une base de données datant d’octobre 2023.

Cette mise à jour est une aubaine pour ceux qui profitent de de la version gratuite de ChatGPT. Jusqu’à présent, ces derniers n’avaient accès qu’à un nombre limité de réponses générées par le puissant GPT-4o, nécessitant ensuite de passer à un modèle moins performant (mais plus économique) pour poursuivre la conversation. C’est un système similaire que l’on retrouve chez d’autres acteurs de l’IA, comme Anthropic avec son moteur de recherche Pro Search ou Claude 3.5 Sonnet.

Heureusement, les choses changent puisque désormais, une fois votre quota limité de réponses GPT-4o épuisé, ChatGPT bascule automatiquement vers GPT-4o mini, bien plus performant que l’ancien GPT-3.5 Turbo.

OpenAI reste discret sur la façon dont ils ont réussi à obtenir un tel niveau de performance avec GPT-4o mini. Une chose est sûre : ce modèle est bien plus efficient que ses prédécesseurs. Son coût pour les développeurs est 60 % inférieur à celui de GPT-3.5 Turbo, et incomparablement moins cher que GPT-4o (facturé à 5 dollars par million de tokens, l’unité de base utilisée par les modèles de langage).